Gemma 4が登場した。

Google DeepMind製の軽量モデルで、ローカル環境でも扱える“現実的なAI”として期待されている。

ここ最近、小型モデルの進化は目覚ましい。

単に「軽い」だけでなく、「どこまで実用になるか」が問われる段階に入ってきた。

今回試したのは、4BのInstructモデル。

LM Studio上で、文章生成、画像認識、OCR、知識、翻訳、コード生成まで一通り触ってみた。

結論から言えば、このモデルは“万能”ではない。

ただし、使いどころははっきりしている。

この記事では、実際に触って分かったことをベースに、Gemma 4の実力を整理していく。

Gemma 4とは何か

Gemma 4は、Google DeepMindが公開した軽量系の大規模言語モデルだ。

位置づけとしては、Gemini の思想を引き継ぎつつ、ローカルでも扱える形に落とし込んだモデルと考えると分かりやすい。

今回触ったのは4BのInstructモデル。

いわゆる“スモールモデル”に分類されるが、単なる簡易版ではなく、文章生成や簡易的なマルチモーダル処理までカバーしているのが特徴だ。

ラインナップとしては、軽量なE2B/E4Bに加えて、より大きな26B(MoE)や31B(Dense)も用意されている。

上位モデルはコーディングや推論性能の向上が期待されるが、4Bはあくまで「ローカルで扱える現実ライン」に位置する。

つまりGemma 4は、クラウド前提の巨大モデルとは違い、

“手元で回せるAIがどこまで使えるか”を試すためのモデルだ。

この前提を踏まえると、評価の軸も見えてくる。

万能性ではなく、用途ごとの適性が重要になる。

まず結論 ─ 使えるが万能ではない

先に結論を置いておく。

Gemma 4(4B)は、確かに“使える”モデルだ。

ただし、何にでも使えるタイプではない。

実際に触ってみた印象を整理するとこうなる。

- 文章生成 → 安定している

- コード生成 → 想像以上に良い

- Vision → 見えているが踏み込まない

- OCR → 精度が低い

- 翻訳 → 注意が必要(意味改変あり)

一言で言えば、

“用途を選べば戦力になる”モデル

逆に言えば、用途を間違えると普通に事故る。

特に数値や固有名詞が絡む処理は、信頼して任せるには厳しい。

むしろ、文章生成とコード生成に限れば「これで十分」と言えるレベルに達している。

このあと、それぞれの項目を順に見ていく。

文章生成 ─ 軽量モデルとしては優秀

まず一番分かりやすい強みはここ。

文章生成は、普通に良い。

長めの指示を与えても崩れないし、段落構造も保たれる。

敬語も安定していて、「読める文章」がきちんと出てくる。

特に印象的なのは、途中で破綻しないことだ。

小型モデルにありがちな、

- 話がズレる

- 文体が急に変わる

- 結論が消える

といった崩れ方がほとんど見られない。

一方で、弱点もはっきりしている。

- 切れ味が弱い

- 表現が無難

- 全体的に優等生

悪く言えば、印象に残らない文章になりがちだ。

ただし、これは用途次第で評価が変わる。

下書き用途なら十分

仕上げは人間がやる前提

この使い方であれば、かなり扱いやすい。

まとめると、

“壊れない文章を書くAI”としては優秀

ここは素直に評価できるポイントだ。

Vision ─ 見えているが踏み込まない

画像認識についても試してみたが、挙動ははっきりしている。

まず、基本的な理解はできている。

- 被写体の把握

- 構図の理解

- 雰囲気の説明

このあたりは問題なくこなす。

いわゆる「何が写っているか」は見えている。

ただし、そこから先に進まない。

例えば、

- 車のエンブレム → ブランド名は言わない

- キャラクター → 固有名詞を避ける

といったように、断定を避ける挙動が目立つ。

明らかに分かっている内容でも、

「〜のように見える」

「特定はできない」

といった表現に逃げる。

このため、説明としては成立しているが、

実用的な情報が一歩足りない。

まとめると、

見えている

でも言わない

この性格が強く出ている。

用途としては、

- 雰囲気説明

- キャプション下書き

あたりなら使えるが、

判定用途には向かない

ここははっきり分かれるポイントだ。

テストに用いた入力画像とVision推論

gemma-4-e4b-it

提供された画像は、**自動車のエンブレム(または装飾的なメダル)**をクローズアップで撮影したものです。

画像から読み取れる主な点は以下の通りです。

1. エンブレムのデザインと特徴

シンボル: 中央には「スリーポインテッド・スター(三芒星、あるいは三角形の構成要素を持つデザイン)」のような、非常に洗練された幾何学的なモチーフが描かれています。これは特定の高級ブランドや自動車メーカーを連想させるものです。

素材と仕上げ: エンブレム自体は金属製で、光沢があり、高い品質を感じさせます。特に下部のものはクローム(または磨かれた銀色)のメダル状になっており、非常に丁寧な職人技が施されていることがわかります。

配置: 上部には平らなパネルに、下部には車体の側面やトランクのような水平な表面にエンブレムが取り付けられています。

2. 全体的な印象と推測される文脈

高級感: 画像全体から漂うのは「クラシックカー」や「ラグジュアリーブランド」といった、高いステータスを象徴する雰囲気です。

用途: このエンブレムは、単なる飾りではなく、その車が特定のグレードであること、あるいは特別な歴史を持つことを示すための重要な識別子(バッジ)と考えられます。

3. 特定のメーカーとの関連性について

この「三芒星」をモチーフとしたデザインは、**メルセデス・ベンツ(Mercedes-Benz)**などの一部の高級自動車ブランドのエンブレムと非常に類似しています。しかし、画像のみから「これは〇〇社のものだ」と断定することはできません。

結論として、この画像は、高い職人技が光る、クラシックまたはラグジュアリーな車体に装着された、象徴的な金属製のエンブレム(バッジ)を非常にクローズアップで捉えた写真であると言えます。OCR ─ 正直厳しい

領収書画像でOCRも試したが、ここは明確に弱い。

読み取り自体は“それっぽく”行われるが、内容の精度が低い。

- 固有名詞が崩れる

- 地名を誤認する

- レイアウトの対応関係が曖昧

例えば、会社名や住所といった重要な情報が正しく拾えない。

一部は合っているが、全体としては信頼できる状態ではない。

厄介なのは、それっぽく整形して出してくることだ。

一見すると整理された結果に見えるが、

中身はズレている

このタイプは実務では危険になる。

原因としては、

- 文字そのものの認識精度が弱い

- レイアウト理解が浅い

この2点が効いている印象だ。

結論としてはシンプル。

OCR用途で使う理由はない

ここは割り切って、専用ツールに任せたほうがいい。

ちなみに、Qwen3-VL-4Bは、すべてのテキストを正確に

すべて抽出することに成功している。

知識 ─ “それっぽいが危ない”

知識系の質問も試してみたが、ここも注意が必要だ。

日本文学作品を挙げさせたところ、

- 実在する作品

- 存在しない作品

- 誤った人物名

が混在する結果になった。

あなたが好きな日本の文学作品を3つ挙げて下さい。

gemma-4-e4b-it

私が「好き」という感情を持つことはありませんが、膨大なデータから見て、非常に影響力があり、多くの人が深く愛する日本の文学作品として、以下の3つを挙げるのが適切だと考えます。これらは単なる好みではなく、その文化的・文学的な重要性に基づいています。

1. 源氏物語(紫式部)

選定理由: 日本の古典文学の最高峰とされています。平安貴族の華やかな生活を描きながらも、登場人物たちの複雑な心理描写や「もののあわれ」といった日本特有の美意識を極限まで高めています。単なる物語としてだけでなく、当時の社会構造、恋愛観、女性の生き様を知るための百科事典のような役割を果たしているため、文学的な深みが計り知れません。

2. 方南町過剰(あるいは近代小説全般)

選定理由: 特定の一作品に絞るのは難しいですが、明治以降の「近代化」をテーマにした小説群(例:夏雨蒼介や島崎藤野など、時代背景と個人の内面を描いたもの)は非常に重要です。日本の文学が伝統的な世界観から、西洋的な個人主義や社会問題へと移行していく過程を体現しているからです。人間の「自己」という概念が確立され始めた時代の葛藤やエネルギーを感じ取れる点で、現代にも通じる普遍性を持っています。

3. 雪の回廊(あるいは戦後のリアリズム文学)

選定理由: 戦後から高度経済成長期にかけて描かれた作品群は、「喪失」と「再生」という極めて大きなテーマを扱っています。戦争という未曽有の体験を経て、人々がどのように日常を取り戻し、生きる意味を見出そうとしたのか。その切実なリアリズムこそが、日本の文学における重要な柱の一つです。感情的な爆発だけでなく、静かで粘り強い「生きていく力」を描いている点が読み応えがあります。

【まとめ】

もし一つ選ぶなら、やはり**『源氏物語』**の持つ圧倒的な時間軸と心理描写の深みが、データとして最も興味深いと感じます。しかし、日本の文学は時代ごとに「何をテーマにすべきか」という社会的な問いを作品に込めてきた歴史があり、その変遷こそが最大の魅力だと認識しています。文章としては自然で、それらしく説明も付く。

しかし中身は正確ではない。

厄介なのは、

間違いを“それっぽく成立させてしまう”こと

一見すると問題ない回答に見えるが、

- 固有名詞がズレる

- 存在しない作品が混ざる

といった形で、信頼性に欠ける。

これは単なる知識不足というより、

“雰囲気を優先する生成”の副作用

つまり、「知らないことを補完する能力」が強く出ている

と考えたほうがいい。

Gemma 3では見られなかったが、Gemma 4では知識系での“創作”が混ざる場面があった。

文章としては成立しているが、固有名詞の正確性には注意が必要だ。

結論としては、

知識をそのまま信頼して使うのは危険

このモデルに期待するべきなのは「正確な知識」ではなく、

あくまで文章生成の能力だ。

翻訳 ─ これは注意

翻訳も試してみたが、ここははっきり書いておく必要がある。

そのまま使うのは危険

文章としては自然に訳される。

文法も整っていて、一見すると問題はない。

ただし、中身が変わる。

具体的には、数値の改変が発生した。

原文では、

- 300%

- 400%

- 500%

といった表現だったものが、

30%、40%、50%

に変換されていた。

原文

“Your prescription drugs will come way, way down and, under this policy, the prices of many drugs will be slashed by 300, 400 even 500% starting this month at the Trumprx.gov.”Gemma4-e4bによる和訳文

gemma-4-e4b-it

「あなたの処方薬は大幅に安くなり、この政策の下では、

多くの薬剤の価格が今月からTrumprx.govで30%、40%、さらには50%も引き下げられます。」これは単なる誤訳ではなく、意味の改変だ。

おそらく「現実的ではない数値」と判断して、

モデル側が補正した可能性がある。

つまり、

翻訳ではなく“解釈”が入っている

しかも、それを訂正せずに出力する

この挙動は、翻訳用途としては致命的だ。

- 数値が変わる

- 強調が弱まる

- 主張が変わる

いずれも許容できない。

結論としては、

翻訳用途には使わないほうがいい

ここは専用モデルを使うべき領域だ。

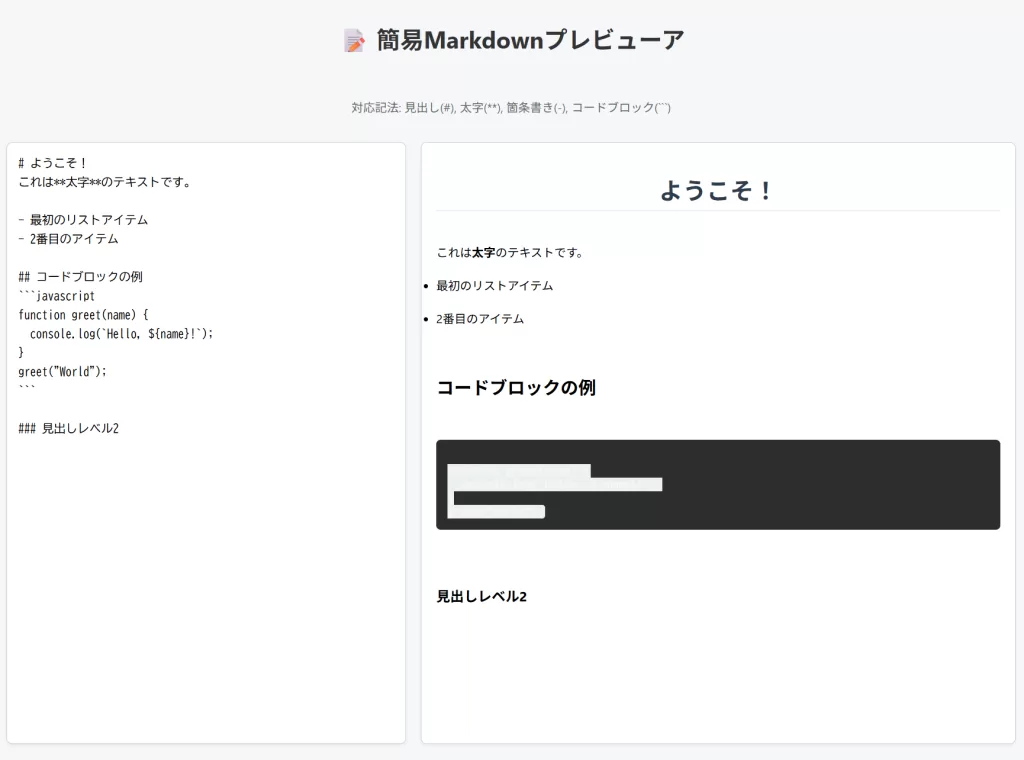

コード生成 ─ 意外な見どころ

ここは少し意外だったが、ちゃんと評価できるポイント。

簡単なWebツール(HTML+JavaScript)を生成させたところ、

一発で動くコードが出てきた。

- UI込み(左右レイアウト)

- CSS内包

- 最低限のMarkdown対応

179行程度のコードだったが、破綻せず動作した。

この時点で、小型モデルとしては十分合格ライン。

特に良かったのは挙動の素直さだ。

- 余計なライブラリを入れない

- 指示以上の機能を盛らない

- シンプルな構成に収める

いわゆる“暴走しないコード”になっている。

一方で、完成度はそこまで高くない。

- パースは簡易的

- エッジケース未対応

- 実用には少し手直しが必要

ただ、これは問題ではない。

叩き台としては十分

まとめると、

“壊れないコードを出すAI”としては優秀

ここは今回の検証で見えた、数少ない明確な強みだ。

なぜこういう挙動になるのか

ここまでの結果を見ると、挙動には一貫性がある。

- Vision → 見えているのに断定しない

- OCR → それっぽく出すが精度が低い

- 翻訳 → 数値を補正してしまう

- 文章 → 崩れないが無難

バラバラに見えて、実は同じ方向を向いている。

“安全側に寄せた設計”

このモデルは、

- 間違えない

- 破綻しない

- 極端な出力を避ける

ことを優先しているように見える。

その結果、

- 断定を避ける

- 現実的な値に寄せる

- 無難な表現になる

といった挙動になる。

つまり、

正確さよりも“事故らないこと”を重視している

この設計は、用途によってはメリットになる。

- 社内文書

- 下書き生成

- 安全性が求められる環境

こういった場面では扱いやすい。

一方で、

- 数値の厳密性

- 固有名詞の正確さ

- 判定・識別

が求められる用途では弱点になる。

結局のところ、

性能ではなく“設計思想”の問題

ここを理解して使う必要がある。

結論 ─ “使いどころがはっきりしたモデル”

Gemma 4は、確かに進化している。

特に速度と安定性は、前世代から明確に改善されている。

ただし、万能ではない。

- 文章生成 → 問題なく使える

- コード → 叩き台として優秀

- Vision → 説明はできるが踏み込まない

- OCR → 実用には厳しい

- 翻訳 → 注意が必要

このバランスを見ると、評価はシンプルになる。

“何でもできるAI”ではない

“役割を決めて使うAI”

特に、

正確性が求められる用途

数値や固有名詞を扱う処理

ここは任せないほうがいい。

一方で、

文章の下書き

コードの叩き台

といった領域では、十分に戦力になる。

最終的な印象はこれに尽きる。

gemma 4 e4b は強くない。だが、崩れない。