「日本はもう終わりだ..」

そんな言葉を、ここ数年よく聞くようになった。確かに、派手な覇権争いでは後れを取っているのかもしれない。だが、すべてが終わったわけではない。目立たない場所で、静かに構造を変えようとしている動きがある。富士通らが発表した「PHOTON」も、そのひとつだ。

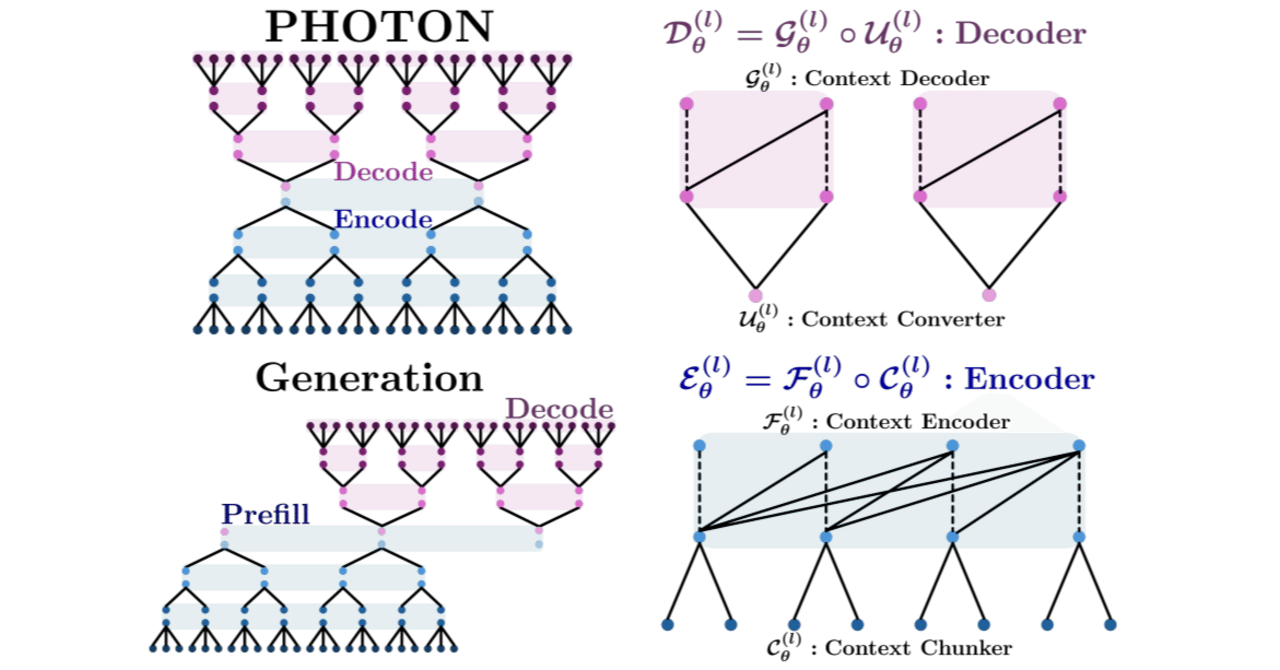

PHOTONとは何か

PHOTONは、従来のTransformerとは異なる構造を持つ言語モデルだ。最大の特徴は「階層構造」にある。

従来のLLMは、文章を1トークンずつ順番に読み込んでいく。

いわば、横に長く読む構造だ。対してPHOTONは、一度情報を圧縮し、

必要な部分だけを細かく復元する。すべてを同じ解像度で読むのではなく、

粗く読み、必要なところだけ深く読む。この発想そのものが、従来とは異なる。

何を変えたのか ─ 「横読み」からの脱却

LLMが遅くなる理由は単純だ。長くなるほど、読む量が増えるからだ。

しかも、その処理は基本的に逐次的で、メモリも時間も比例して増えていく。

PHOTONはここに手を入れた。

すべてを順番に読むのではなく、階層的に圧縮しながら理解する。そして、必要な部分だけを並列で復元する。全ページを精読するのではなく、まず要約し、必要な箇所だけ読み込むようなものだ。読み方そのものを変えた。

なぜそれが重要なのか ─ メモリという現実

AIの進化を止めている最大の要因は、計算能力ではない。メモリだ。モデルは巨大化し、文脈は長くなり、

KVキャッシュは膨れ上がる。

その結果、高速化しても、どこかで頭打ちになる。PHOTONは、この問題から逃げなかった。TurboQuantのような美しい理論とは違う。だが、現実はもっと泥臭い。AIはメモリを食い潰す。

その制約の中で、どう動かすか。PHOTONは構造を変えることで、そこに切り込んだ。

この設計にある“個人の匂い”

このアプローチには、どこか個人の発想らしい鋭さがある。最適化の延長ではなく、前提そのものを疑っている。グループワークでは洗練されることはあっても、こうした飛び方はなかなか出てこない。一人の思考が、構造に直接刻まれているような感触がある。もちろん、研究はチームの成果だ。だが、最初のジャンプは、個人の頭の中で起きていることが多い。

何が変わるのか

この方向性が進めば、いくつかの変化が見えてくる。

まず、長文処理の現実化だ。これまでRAGや分割処理に頼っていた領域が、構造そのものの進化で解決される可能性がある。

次に、ローカルAIの復権。メモリ効率が上がれば、巨大なインフラに依存せずに動かせる余地が広がる。そして、推論コストの低下。これはクラウド前提の構造に対して、静かに効いてくる変化だ。

派手ではないが、確実に効く

この技術は、派手ではない。だが、確実に効く。

- 技術ロマン:中

- 実務インパクト:高

- 市場破壊力:じわじわ型

一気に世界を変えるタイプではないが、気がついたときには前提が変わっている。そういう種類の技術だ。

日本はまだ終わっていない

目立つことはなくても、

誰かが地道に問題を解いている。その積み重ねが、

ある日、流れを変えることがある。

少なくとも、まだやれるだけの土台は残っている。

雌伏の時代は、もうすぐ終わるのかもしれない。

参照