ローカルで動く音声認識(ASR)の選択肢が増えてきた。

Whisperを軸にしつつ、MoonshineやCohere Transcribeなど、方向性の違うモデルが出揃ってきている。

その中で、少し毛色の違う存在が Qwen3-ASR 1.7B だ。

pipで導入できる手軽さと、比較的軽量なサイズ。

“触れるASR”として気になる存在ではあるが、実際に使えるのか。

今回は比較は行わず、単体で評価する。

Qwen3-ASR 1.7Bとは何か

Qwenシリーズの音声認識モデルで、1.7Bという比較的軽量なサイズに収まっている。

特徴として分かりやすいのは以下の2点。

- pipでインストールできる

- 公式APIが用意されている

Whisperのような“事実上のデファクト”にはまだ及ばないが、

導入のしやすさという意味ではかなり現実的なラインにいるモデルだ。

実行環境

- Intel i7 8700

- RTX 3060(12GB)

- Python 3.10

- CUDA対応PyTorch

- transformers

検証条件

- 使用素材:地方議会の会議音声(日本語)

- 実行環境:ローカルGPU(RTX3060)

- 評価観点:

- 誤変換

- 文の自然さ

- 情報の欠落

素材と処理フロー

実験素材には過去検証でも用いた、春日部市議会 令和7年9月定例会 議案質疑(1日目) の公式アーカイブ動画を用いました。

- ライブ映像アーカイブ: 春日部市議会インターネット中継

- 動画ファイル: MP4ダウンロード

chunk_000.mp3

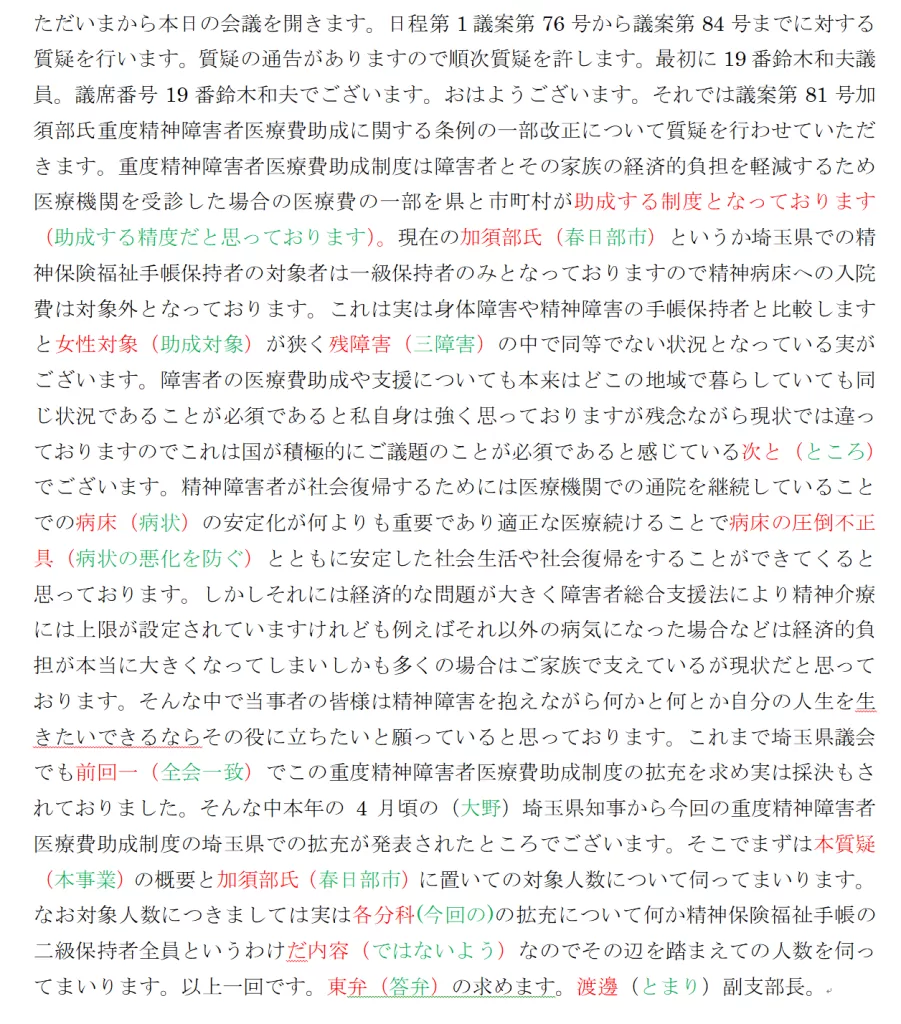

出力結果

出力の特徴とクセ

ここからが本題。

単体評価として見たとき、Qwen3-ASRにははっきりした“性格”がある。

句点が少ない(かなり目立つ)

まず一番気になるのがこれ。

文がほとんど区切られず、長く連結される。

結果として、読みやすさはあまり高くない。

一般的な「整った文字起こし」と比べると、

- 文の区切りが弱い

- 呼吸の位置が分かりにくい

👉 “読みやすい文章”ではなく、“整形されていないテキスト”

これは明確にモデルの出力特性と言っていい。

圧縮(端折り)が入る

もう一つ大きいのがこれ。

出力されたテキストは、元の発話より明らかに短い。

体感で20%前後は削られている。

- 言い淀み

- 重複表現

- 冗長な言い回し

こういった部分が削られている。

一見するとスッキリしているが、

👉 これは“忠実な文字起こし”ではない

👉 軽い要約が混ざった挙動

と見るべき。

意味がズレるケースがある

ここは注意点として外せない。

いくつか具体例を挙げる。

- 女性対象 → 本来は「助成対象」

- 病床 → 本来は「病状」

- 東弁 → 本来は「答弁」

- 前回一 → 本来は「全会一致」

- 加須部氏 → 本来は「春日部市」

単なる誤変換ではなく、

意味そのものが変わるタイプのズレ

が発生している。

このタイプは後処理で気づきにくく、

そのまま使うと内容が歪むリスクがある。

ドメイン語に弱い

議事録特有の語彙にも弱さが出る。

例えば:

- 三障害(身体・知的・精神)

- 医療制度系の用語

- 行政用語

このあたりは文脈で補完されず、崩れるケースが見られる。

専門領域の音声にはやや不向き

使ってみて感じたこと

導入は正直かなり楽だった。

pip install qwen-asr

これで一通り揃うのは大きい。

- 環境構築の再現性が高い

- 依存関係で詰まりにくい

- とりあえず動かせる

この点は強い。

ただし出力については別の話になる。

そのまま使える品質ではない

必ず人力チェックが必要

これはQwenに限った話ではないが、

Qwenは特に“意味のズレ”が混ざるため、見逃しにくい。

このモデルはどこで使うべきか

用途として合っているのはこのあたり。

- 音声の粗いテキスト化

- 下書き生成

- 軽量環境での利用

逆に、

- 正確な議事録

- 法的文書

- 公開前提の文章

こういった用途には、そのままでは使いづらい。

“素材を作るモデル”であって、“完成させるモデル”ではない

結論

Qwen3-ASR 1.7Bは、

使えるASRではある

ただし、

任せられるASRではない

導入のしやすさは大きな魅力だが、

出力は必ず確認が必要になる。

補足

ASRはもう「どれが一番精度が高いか」で選ぶ時代ではない。

- 導入のしやすさ

- 運用のしやすさ

- 出力の性質

このあたりで評価が分かれていく。

Qwen3-ASRはその中で、

“現場に持ち込める軽量ASR”

としてのポジションにいるモデルだ。