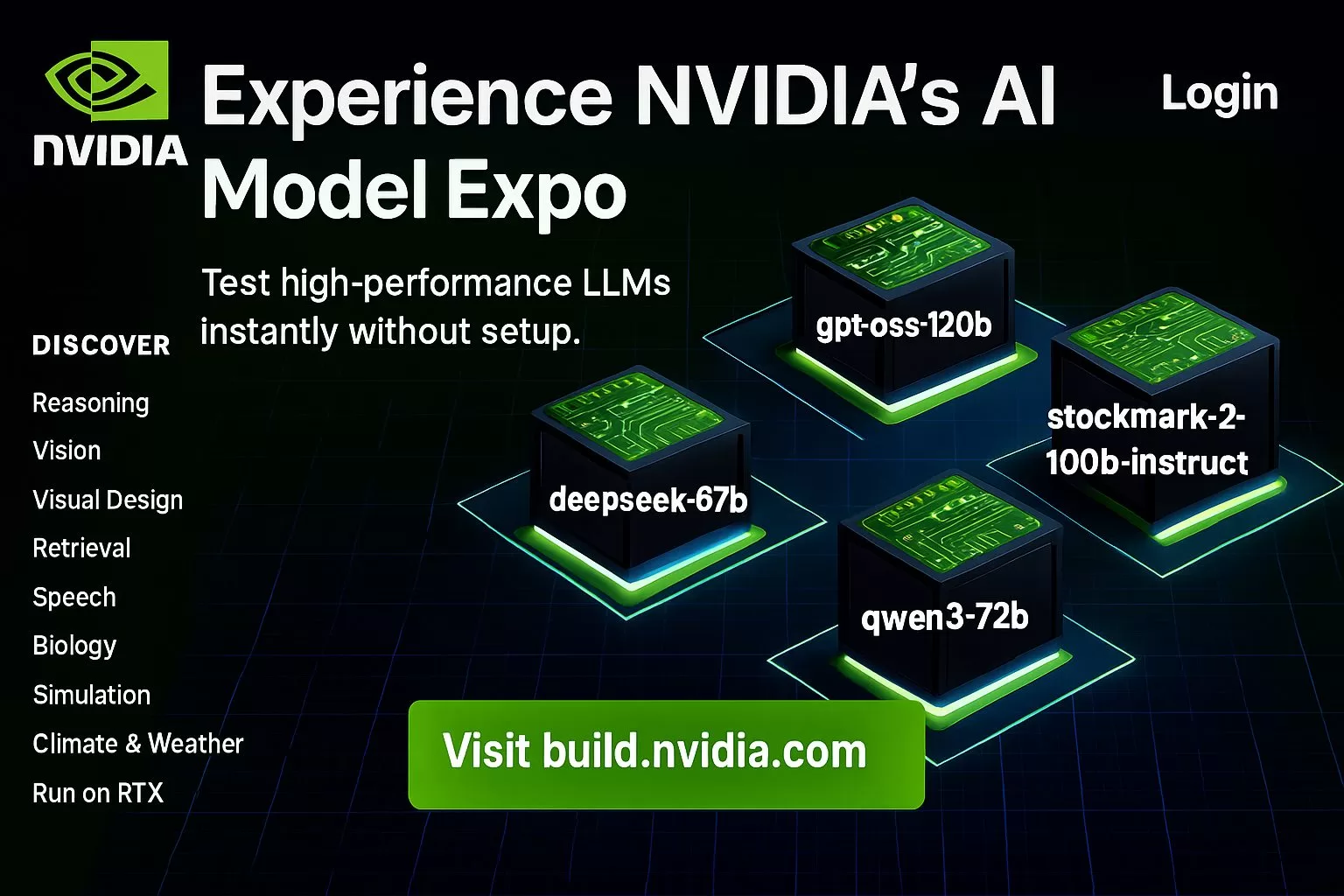

NVIDIA「AIモデル万博」とは何か

NVIDIA がひっそりと公開しているサイト Build.NVIDIA.com。

ここに足を踏み入れると、まるで「AIの万博」に迷い込んだような体験が待っています。

大げさに聞こえるかもしれませんが、実際に触れてみると、これはただの技術デモではありません。

世界中の最新オープンウェイトモデルが一堂に会し、しかも 環境構築不要で即座に試せる──この一点だけでも、研究者や開発者にとっては衝撃的な価値があります。

たとえば Hugging Face Hub のように「モデルを探してダウンロードしてから試す」仕組みとは異なり、ここでは ブラウザからそのまま動かせる最高の実行環境が用意されているのです。

複雑なセットアップや高額な GPU インフラの準備は一切不要。リンクを開いて入力を投げれば、そのモデルの持つポテンシャルを体感できる。

この「環境構築不要の試遊場」という仕掛けが、NVIDIA の凄さです。

同社にとっては、自社 GPU の性能を存分にアピールする「舞台装置」であり、同時に世界中の研究者・開発者に向けたショールームでもあるのでしょう。

そして、この場所を一度でも覗けば「AIモデルの未来はここにある」と直感できるはずです。

展示されているのは単なる配布物ではなく、「即実行可能な体験」。

それが積み重なることで、まさに「万博」と呼ぶにふさわしいスケール感を醸し出しています。

モデルの展示場を歩く

会場に一歩足を踏み入れると、視界に飛び込んでくるのは多彩なカテゴリーのAIモデル群。

Build.NVIDIA.com では、単なる「LLMの寄せ集め」ではなく、領域ごとに整然と並んだカタログ展示が用意されています。まるで巨大な展示ホールを巡るように、モデルの世界を渡り歩けるのです。

Reasoning ─ 思考するモデルたち

まず目を引くのは「Reasoning」のコーナー。

ここには gpt-oss-120b や qwen3-80b といった大規模推論モデルが並び、いずれも 128k という広大なコンテキスト長を誇ります。ただし、この試用環境でどこまでフルに発揮されているかは分かりません。NVIDIA 側の設定によっては制限がある可能性もあります。とはいえ、実際に10万字級テキストを食わせて要約できた、というのは明らかな成果でした。

普段なら巨大GPUを用意しなければ実行すらできないモデルを、ブラウザ越しにワンクリックで試せる──それだけで「ここは特別な場所だ」と実感できます。

しかも、国産LLMの Stockmark-2-100B-Instruct が肩を並べている点は見逃せません。国内開発の100B級 LLM を体験できる場所は極めて限られており、ここで触れられること自体が貴重な機会です。

Speech ─ 声を聴かせるAI

続いて「Speech」のエリア。

ここでは Whisper-large-v3 などの音声認識モデルが実際に動作し、WAVファイルをアップロードしたりして試すことができます。

残念ながら日本語には非対応でしたが、「その場でファイルを投げて即座に変換が走る」体験は、ローカルで環境構築するのとは別次元の手軽さ。

Vision & Diffusion ─ 目と創造力を持つモデル

さらに歩を進めると、「Vision」「Diffusion」の展示区画へ。

ここには Stable Diffusion 系のモデルカードも並んでおり、画像生成や視覚認識の研究がどのように進んでいるかを一覧できます。

一部は実行可能ではなく「モデル紹介」に留まりますが、APIやデプロイ方法がまとめられていて、まさに研究者向けカタログの決定版といった趣き。

一堂に会する「万博」の空気

こうした多様なカテゴリを渡り歩くうちに気づくのは、単なる技術展示を超えた「万博的」な空気感です。

言語、音声、画像──世界中の研究機関や企業が開発した最前線のモデルが、NVIDIA の舞台上で共演している。

そのラインナップを見渡すだけで「今のAIの全体像」が一望できるのです。

体感するパフォーマンス ─ 10万字クラスの要約の実験

展示を見て回るだけでも十分に圧倒されますが、せっかくなら実際に使ってみたい。

そう思い立って試したのが、令和5年度 年次経済財政報告 第1章──その文字数はおよそ 95,000字に及ぶ超大規模な文書です。

通常であれば、この分量のテキストをそのまま大規模言語モデルに投げ込むのは至難の業です。

ローカル環境であれば GPU メモリや推論時間の制約にすぐ引っかかり、分割やチャンク化なしに処理するのはまず不可能。

ところが、NVIDIA の「AIモデル万博」環境では、これを一発で要約できてしまったのです。

実験の手応え

- DeepSeek

英語ではそれなりにまとまった要約を返す一方で、日本語では中国語や英語が混じる出力が多く、実用的な読み物としては破綻してしまう印象。構造は掴んでいるものの、言語面で致命的に使いづらい。 - Qwen3-80B

同じ中国系ながら、こちらは日本語でも比較的まともな要約を返し、モデルごとの「カラー」の違いを実感。 - GPT-OSS 120B

群を抜いて安定。日本語でも流暢かつ構造化された要約を生成し、「これが本来の性能か」と納得させられました。

普段では味わえない「贅沢な試み」

10万字規模を丸ごと読み込ませ、そのまま要約を受け取る──。

これは、普段の環境では到底できない「贅沢な実験」です。

クラウド課金を恐れることもなく、ローカルGPUのメモリ不足に悩むこともなく、ただ試すだけで済む。

体感として驚かされるのは、レスポンスの鋭さでした。

大規模推論にもかかわらず、待ち時間は想像よりずっと短く、出力は滑らか。

裏側で稼働しているH100/GB200クラスのGPU群が本気を出すとこうなる──それをユーザー目線で実感できます。

この体験の意義 ─ 一般ユーザーが触れない領域へ

今回の「AIモデル万博」が特別なのは、単なるデモを超えて、普段なら到底触れられない領域を一般ユーザーに解放している点です。

100B級モデルを手元で動かす難しさ

たとえば GPT-OSS 120B や Stockmark-2-100B-Instruct のような 100Bパラメータ級モデル。

これをローカルで動かそうとすれば、最低でも数十GBのVRAMを積んだ H100/GB200 クラスのGPUが必要です。

コンシューマ向けのRTXクラスでは夢のまた夢。研究者や一部の企業でなければ手が出ません。

ここでは「ただ試せる」

ところが、この会場ではクリックひとつでそうした大規模モデルが稼働し、しかも最高の条件でレスポンスが返ってきます。

環境構築に何時間も費やす必要はなく、ハードウェアの心配も無用。

その場で「世界最高峰の推論体験」を味わえる──それだけで十分に革命的です。

実地検証の場としての価値

さらに重要なのは、メディアやSNSで話題のモデルを、自分の目と手で確かめられること。

DeepSeek の日本語性能がまだ厳しいこと、Qwen が意外に健闘すること、そして GPT-OSS が安定して強力であること──こうした評価は、実際に動かしてみなければ分かりません。

他人の評判やベンチマークだけに頼らず、自分のユースケースに照らして検証できるのは大きな強みです。

これは「万博」そのもの

結果として、この場所は「NVIDIAのショールーム」であると同時に、AIの未来を体感できる博覧会場でもあります。

訪問者は展示を楽しみつつ、「あ、これを手元で動かしたい」と思うようになる。

そして実際に高性能GPUを欲しくなる。そう考えると、NVIDIA にとっても極めて巧妙な導線設計だと感じます。

まとめ ─ 「AIモデル万博」を体験しよう

NVIDIA が提供する Build.NVIDIA.com は、単なる技術サイトではありません。

そこには世界中の最新モデルが整然と並び、環境構築の手間も、GPUの制約もなく、その場で最高性能を味わえる「AIモデル万博」が広がっています。

- Reasoning コーナーでは、GPT-OSS 120B や Qwen3-80B といった大規模 LLM が稼働。

- Speech エリアでは、Whisper などの音声モデルをアップロードして試せる。

- Vision や Diffusion では、Stable Diffusion 系のモデルカードが並び、研究の最前線が見渡せる。

- そして、国産の Stockmark-2-100B-Instruct という貴重な100B級 LLMに触れられることも、この場所ならではの体験です。

筆者自身、95,000字という巨大テキストを投入し、複数のモデルに要約させる実験を行いました。

普段の環境では不可能な規模感を、ブラウザから一発で体験できる。

その驚きとワクワク感は、まさに「万博」の名にふさわしいものでした。

これは決して研究者や大企業だけの特権ではありません。

誰でもアクセスし、世界最高峰のモデルを動かせる。

その意味で、このサイトは「未来のAIがどんな顔をしているのか」を一般ユーザーに開放した窓口でもあります。

NVIDIA にとっては潜在顧客を掘り起こす場かもしれませんが、訪問者にとっては「夢の試遊場」。

だからこそ、声を大にして言いたいのは──

ぜひ一度、自分の手で体験してほしい。

AIの最前線が、ブラウザひとつでここまで身近になるのか。

その感覚を味わうだけでも、この万博を訪れる価値は十分にあります。

万博の会場はこちらです..