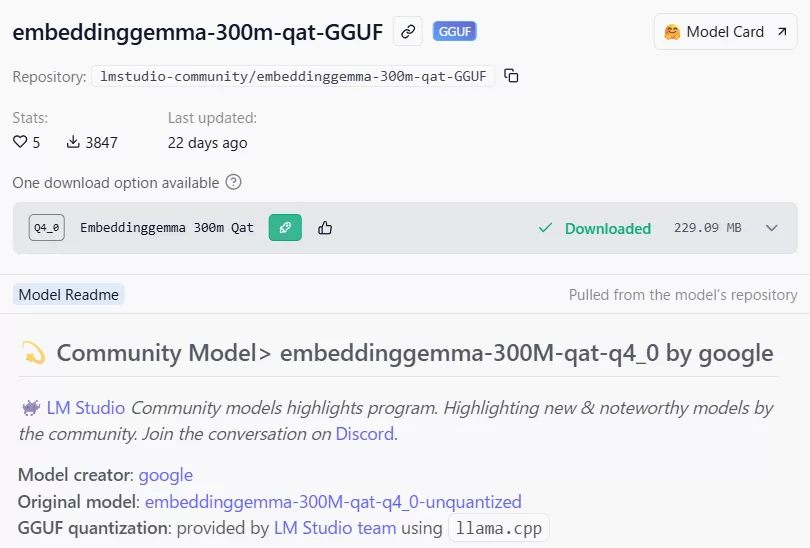

LM Studioに「Embedding Gemma」というモデルが並び始めました。

見慣れたチャット用Gemmaとは違い、これは会話ができるLLMではありません。リストに現れるのは「Text Embedding」の欄。ひたすら文章をベクトルに変換するだけの存在で、モデルのロードもできません。

そもそも埋め込み(Embedding)は何をしているのでしょうか。簡単に言えば「文章の意味を数値で表現する」処理です。例えば「ラーメン」と「中華そば」は文字列としては違いますが、Embeddingを通せば近い位置に並ぶベクトルとなり、互いに関連が深いことを計算機が理解できるようになります。

この仕組みがよく使われるのがRAG(検索拡張生成)です。ユーザーの質問をEmbeddingで変換し、同じくEmbedding済みの文書群と照合すれば、関連性の高い情報を取り出してLLMの回答精度を高められる。Gemmaの埋め込みモデルも本来はそうした用途を想定しています。

ただし、用途はRAGに限りません。FAQ検索や社内マニュアルの整理、問い合わせメールの自動仕分けなど、規模が小さい現場ほどEmbeddingの“軽さ”が効いてきます。わざわざ大規模なベクトルDBを構築しなくても、数百〜数千件規模であればオンザフライの比較で十分に意味検索ができてしまう。Embedding Gemmaはそのような軽量でローカル完結する意味検索エンジンとして位置づけると、しっくりきます。

一方で、PDFやWordといった非テキスト資産を直接扱えるわけではなく、前処理を挟む必要があります。そのため「魔法の検索装置」ではなく、テキスト前提のツールだと割り切って使うのが現実的です。

結局のところEmbedding Gemmaは「万人に便利な道具」ではありません。

しかし、クラウドを介さずに手元で動かせる小さなEmbeddingモデルとして、ピンと来る人には大きな武器になる。LM Studioに並んだその名前は、そうした使い道を見つけた人にとって意味を持つでしょう。

参考:Embedding Gemma のタスクタイプ一覧

Embedding Gemma は用途に応じて「どんな埋め込みを作るか」を切り替えられるのが特徴です。タスク指定によって生成されるベクトルの意味付けが変わります。

- Retrieval(Query)

検索クエリ用の埋め込み。task: search result | query: {content} - Retrieval(Document)

検索対象文書用の埋め込み(タイトルを与えると精度向上)。title: {title | "none"} | text: {content} - Question Answering

質問応答向けのクエリ埋め込み。task: question answering | query: {content} - Fact Verification

事実確認向けの埋め込み。ファクトチェック用途。task: fact checking | query: {content} - Classification

ラベル分類用の埋め込み。task: classification | query: {content} - Clustering

文の類似性に基づいてグループ化するための埋め込み。task: clustering | query: {content} - Semantic Similarity

文同士の意味的な類似度判定に最適化。検索には非推奨。task: sentence similarity | query: {content} - Code Retrieval

自然言語クエリとコード片をマッチングするための埋め込み。task: code retrieval | query: {content}